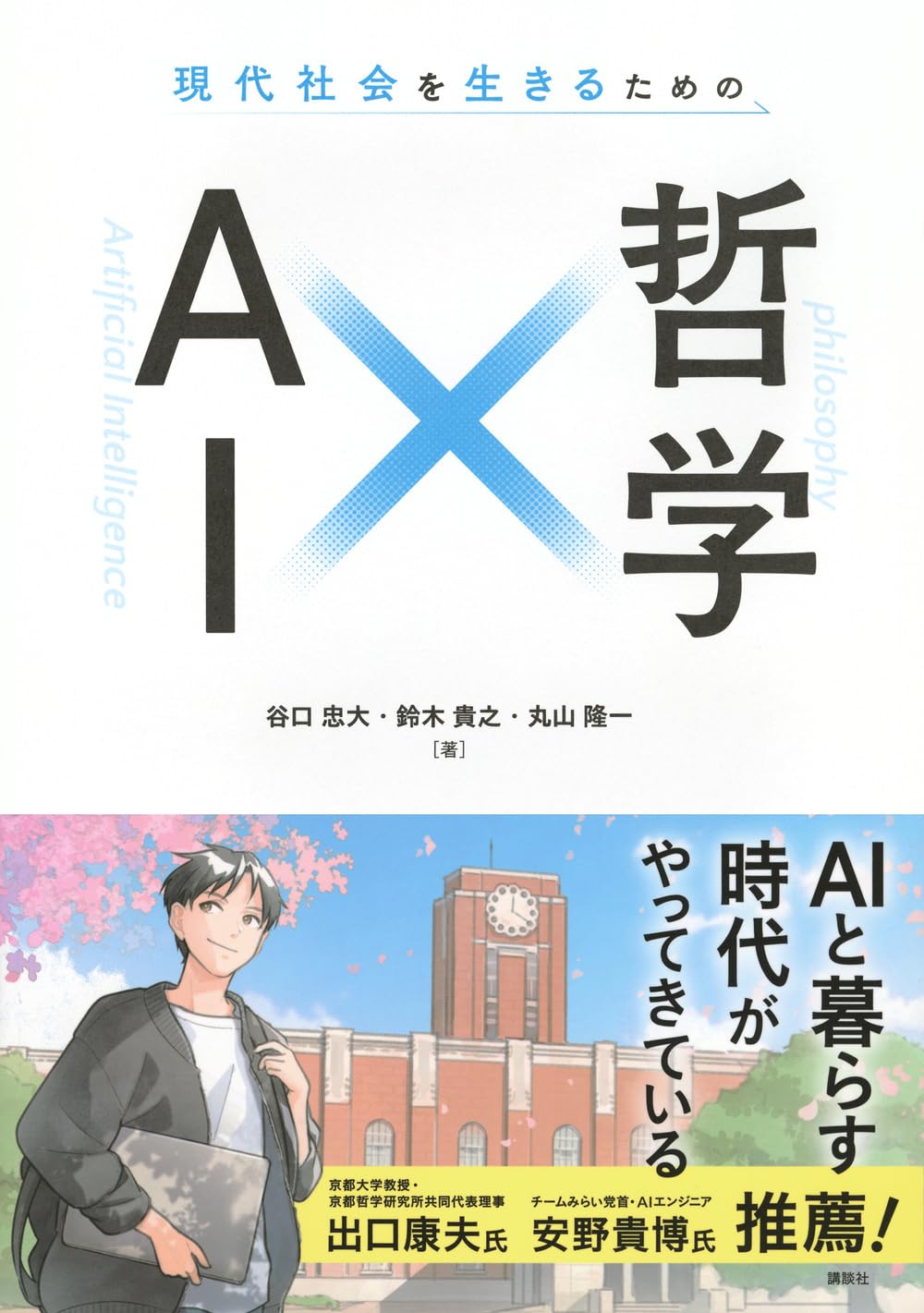

現代社会を生きるための AI×哲学

一覧に戻る読書中の感想:

はじめにの文章の時点でかなり良い本だと感じた。こういう、未来について様々な視点から考えさせられる本が読みたかった。これから読んでいくのが楽しみ。

AIは後に続く言葉を予測して出力しているだけという話は何度も聞いたことがあるが、どのようにして自然な対話を実現しているのかはあまり理解できていないことに気づいた。

AIは膨大なデータを扱えるようになったから実現できたのではなく、逆にこのままではデータがあふれて人の手では処理しきれないから実現されたという説もあるかもしれないなとこの本を読んでいて感じたが、おそらく誤りだろう。

最初の方の章は、広義でのAIに関する歴史なので、自分は情報学を少しかじっているので人物名や論文名、手法名が紹介されても「あぁ、あれか!」となって面白いが、情報学に全く触れていない人には読んでいて退屈かもしれないなと感じた。まぁでも本書いわく、歴史を知らずしてAIは語れないみたいなことを言っていたので、ここは大事なのだろう。

最近はAI人材の雇用が加速しているみたいだが、昔は(と言っても自分が学部1,2年の頃なので全然昔ではないけど)統計や機械学習ができる、数学科の人材の雇用が加速していたけど、そういう雇用は最近アなくなってきているのかな。AIがあれば別に統計用の人材を雇用しなくてもいいもんね・・・。時代が変わるのは速いなぁと感じた。

なんか言語化は難しいんだけど、量子コンピュータは、現状の課題を克服する能力を持っているから、絶対に量子コンピュータの時代が来るなと思う。同時に並列して複数の実行をし、最適なものを選ぶというのは、人間の思考にとても似ていると思うから。量子コンピュータには期待したい。量子通信はどうなんだろうか。

AIの登場により、意識とは何かとか、人間であるとはどういうことかという哲学的な問いを考え直すべきだと本書では主張していた。自分の感覚としては、考え直すことによって定義を別物にするのではなく、よりよいものにアップデートするべきだと思う。そうでないと、過去からの成長がないと、技術を進歩させる意味がないと思うから。こういった哲学的な問いもそうだし、倫理的な問いなどすべてをアップデートするときが来たのではないか。このアップデートの仕方によって人類の行く末が決まるのではないか。壮大な話になってしまったけど、それぐらい重要な時代に自分は生きていると思う。

第一次AIブームでは、記号的AIが流行した。記号的AIは記号論理学をもとにしている。自分のイメージでは、記号論理学は現実の一部の事象しかとらえられない(リンゴと言われれば代表的な赤いリンゴしかコンピュータは認識できない)という認識(必要条件?の一つしか認識できない)だったので、LLMで扱っているのはそれよりも広い、十分条件?に近い認識ができていると思うので、記号的AIに関しては、LLMの下位互換だという印象があるが正しいのだろうか。つまり、記号的AIは学ぶ必要がないと思っているのだけど正しいのだろうか。ただ記号的AIはハルシネーションは絶対にしない(答えが一つに定まるものしか扱わないと思っている)という点ではLLMよりも優れていると思うが、そもそも現実の一部の事象しかとらえられないという弱点を補うために確率を持ち出してきたと思うので、やはり記号的AIはLLMの下位互換なのではないか。

→そういうわけではなく、記号的AIの技術の基盤とLLMの基盤は異なるので、下位互換というわけではなく、全く別の技術。さらに、両社を組み合わせることでAIの性能を上げるような研究領域も存在する。

AIにできること、できないことについて、少し思うことがある。AIは、過去の経験が必要なものや他の事象からの応用が苦手だと思う。自動運転とか、包丁で豆腐を切るとか。ただ、運転に置いていうと、走る前にこれをすべき、曲がる時にはこれをすべきという、人間が忘れがちな?細かいところは得意だと思う。あんまり自信ないけど。そういうところでAIを使うのが良い使い方なのかもしれない。知らんけど。

AIに、慣れは存在するのだろうか。同じ作業を何回もやってると効率が上がるのだろうか。内部構造的に、推論をしている限りはあり得ないのかもしれないな、そういう点で人間に近づけていないのかもしれないなと感じた。

第一次AIブームにおける記号的AIと、今日のAIは異なる基盤だが、なぜ、既存技術を改良するという方向ではなく、全く別の角度から攻めようと思ったのだろう。記号的AIの限界が数学的に証明されたから?

序盤はAIに関する歴史や基礎知識の話なので退屈に感じるかもしれない。

one-hotベクトルは、自分の印象だと計算の高速化ができるから計算負荷が少ないと思っていたけれど、自然言語処理の分野では、one-hotベクトルの弱点(計算量が多い)を補うためにword2vecが提案されたらしいことを知って、one-hotベクトルは実は悪いやつなのでは?と感じた。

今の時代に古典的な言語処理技術(形態素解析や構文解析など)を学ぶ必要があるのかどうか。それらが現在の技術の完全な下位互換ならば学ぶ必要はあまりないと思うが、そうでないならば十分に学ぶ価値があると思う。まぁどういう目的で学ぶのかが大事だよね。

文章内で、ロボットプログラミングをLLMにさせることで自然言語でロボットを制御できるという記述があった。

LLMの得意なことの一つとして、プログラムのコードを書くがある。これは、自然言語で曖昧な指示をするだけで、厳密なコードを書いてくれるというもの。

ここから、三段論法的?に推論すると、プログラミングについて学ぶ必要はなくなると結論付けられるかもしれない。でも、自分の考えとしては、プログラミングについて学ぶ意義は十二分にあると思う。プログラミングを学ぶことにより、できることがわかり創造の幅が増えたり、限界を知ることができると思うから。

でも、本当にそうなのだろうか?

その学ぶ必要というのは、人間が創造をしないといけないという前提や、プログラミングには限界があるという前提があるからではないか。それらの前提がなくなったら、なくなることがあるのだとしたら、学ぶ意義はなくなるのではないか。そういう前提が覆されるかどうかを考えることが重要なのではないか。

8章の認知科学とAI研究との関係の歴史のところで、人間の思考を人工的に再現するためには、体系性や生産性が必要だと言われていた。ただ、現在のLLMは、内部でどのような処理が行われているのかわからないので、体系性や生産性があるのかわからない。だからブラックボックスであることが問題なのだと言われていた。これまで私は、ブラックボックスなのはなぜその答えが出されたのかが分からないから怖くて問題視されているのかなと感じていたが、そういう理由もあるんだなと感じた。体系性や生産性があるのかわからない=なぜその答えが出力されたのかわからないということかもしれないけど。

脳以外の身体と環境の役割が、脳の処理を助けるという話はなるほどなぁと感じた。例えば、49*77は普通の人は脳内で暗算できないが、紙に書けば計算可能。これはすなわち、紙と手とペンが脳の処理を助けたということではないのか、という主張。

9章において、AIは意識を持つのかという話が始まった。特に、自分が印象に残ったのは、AIは自発的に行動できるのかという問い。そもそも人間はなぜ自発的に行動できているのだろう。本能があるから?AIに本能を実装したという研究は存在するのかな?ありそう。そもそも、本能とは何なんだろう。人間の本能はどのようなもので、どのような要素があるのだろう。全員同じなのか、人それぞれ違うのか。これも先行研究がありそう。

8章以降は哲学の話なので、考えさせられる話題なのかなと思っていたが、哲学の研究の概説みたいなもので、多少は考えさせられるが、哲学の研究の内容の説明をされているだけなので、深く考えるまでは至らなかった。自分の能力が低いだけかもしれないが。12章以降はまた毛色が変わるので、深く考えるというのはそこに期待するべきなのかもしれない。深く考えるための教養として、前提知識を学んでいる段階なのかもしれない。

AIを人間に近づけるためにはAIは意識を持つ必要があるが、そもそも意識を持てるのかという問題が9章で紹介されていた。その内容としては、意識の定義を厳密にしすぎると、そもそも人間にさえ意識があるのかさえ分からなくなってしまうということが書いてあった。そこで思ったことは、意識を持つか否かは重要な問題ではないのでは?と直感で思ったが、色々研究されているということは重要な問題なのかなとも思う。

人間とAIが違うのは感情があるかどうかではないか。感情があるから人間はバカみたいな行動をする。ただ、理性だけで動けば客観的には正しく見えるかもしれないが、人間の感情的にはマイナスな感情を抱くと思う。なので、AIが発達すれば人間は支配されるというのは、AIが発達すれば感情が無くなると同義なのではないか。感情があるから人間はバカみたいな行動をするととらえると感情はない方が良いということになるが、本当だろうか?感情により生じているプラスなものはないのだろうか?あると思うけど言語化できるのだろうか?そもそも言語化できないからこのAIに支配されるやらなんやらの論争が終わらないのではないだろうか。

AIに道徳性を持たせるためには、各アカウントごとに異なる道徳性をインストールする必要があると思った。今は超大規模なLLMで推論をしているが、そういう中央集権的な道徳は成立しないと思う。自分がどう思うか、自分にどういう利益・リスクがあるか、自分がどういう思想か、どのような価値観かは人ごとに異なるので、それぞれの人に合った、それぞれの人によって異なる道徳性をインストールしなければいけないのではないかと思った。

書かれている内容が、電子情報通信学会詩と被っている内容が少しあったように感じて、電子情報通信学会詩ってちゃんと網羅しているんだなと感じた(小並感)。

この本を読むまではAIは道具であり、人間がうまく使いこなすべきだ、そのうまく使いこなす方法を模索するべきだという考えだったが、本書ではそういうAI:人間=1:1として考えるのではなく、人間が形成してきた社会の中にどのようにAIが参画すべきなのかを考えるフェーズに来ているという考えに、なるほど!となった。

読了後の感想:

読書前に想定していた、「AI×哲学の答えがないような問題について考えさせてくれるのでは」という期待とは少し異なる内容(もちろん色々考えさせられたが、浅い問いだったように感じた)だったが、AIの知識がない人、哲学の知識がない人でも読める、AI×哲学の入門書のようなイメージがあった。これを機会に、私はAI分野には少し知見がるので、哲学を学び、深い問題についてあれこれ考えてみたいな、考えるの面白そうだなと思ったので、ニーチェの本を買いました。